DeepSeek,这个名字在人工智能领域引起了轩然大波,不仅仅是因为它在大语言模型领域取得了显著的进展,更是因为其背后的关键开发者之一——95后AI天才少女罗福莉。她不仅参与了DeepSeek-V2的研发,而且作为DeepSeek-V3的关键开发者,她的加入使得小米AI实验室如虎添翼。雷军以千万年薪招揽这位年轻人才,不仅体现了对罗福莉个人能力的认可,也彰显了小米对于AI未来投资的决心和远见。

DeepSeek-V3的参数量达到了惊人的671B,激活参数为37B,预训练token量为14.8万亿。这样的数字表明,DeepSeek-V3在规模上已经超越了其他开源模型,如阿里的Qwen2.5-72B和MetadeLlama-3.1-405B,并且在性能上与闭源模型GPT-4o和Claude-3.5-Sonnet不相上下。这标志着DeepSeek在AI领域取得了一次重大的技术突破。

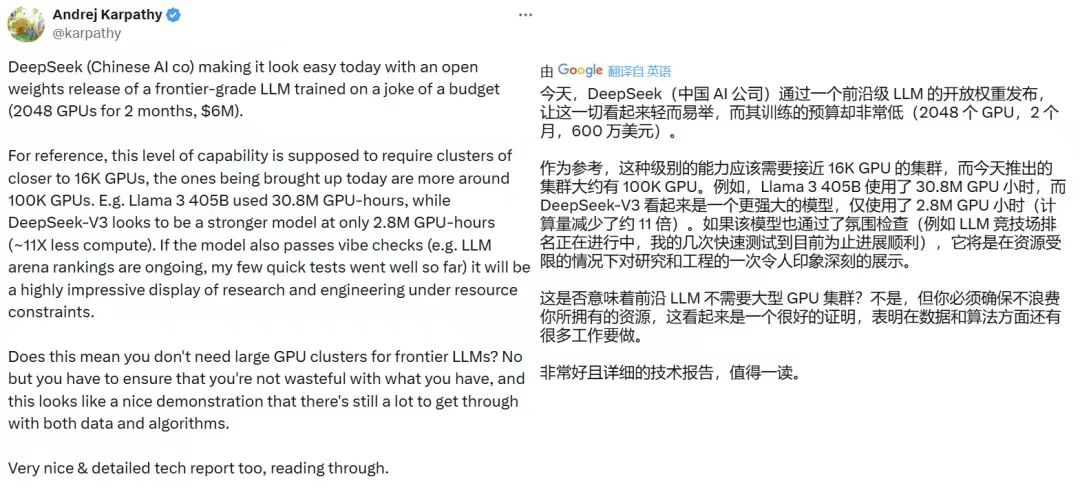

令人瞩目的是,DeepSeek-V3的训练预算非常低。据前OpenAI联创、知名AI科学家Andrej Karpathy的社交平台透露,整个训练过程仅用了不到280万GPU小时,而Meta的Llama-3405B模型则用了3080万GPU小时。这一对比不仅显示了DeepSeek-V3在训练效率上的卓越表现,也从侧面体现了其在资源有限情况下对研究和工程的出色展示。

成本上的对比更是让人印象深刻,如果以H800 GPU的租金为每GPU小时2美元计算,DeepSeek-V3的总训练成本仅为600万美元,而Llama-3405B的超6000万美元训练成本相比之下显得高昂。这一极高的性价比使得DeepSeek-V3一经发布便引发了国内外的广泛关注。

Meta的AI研究科学家田渊栋对DeepSeek-V3在非常有限预算下实现强劲表现给予了高度评价,认为这是一项了不起的工作。知名AI数据公司ScaleAI创始人兼CEO Alexandre Wang也表示,DeepSeek-V3训练所需计算量减少了10倍,展现了其在成本、速度和实力上的优势。

DeepSeek,被誉为AI界的拼多多,专注于开发先进的大语言模型和相关技术。由国内知名量化资管巨头幻方量化于2023年创立,DeepSeek以其高效率和低预算的研发策略,从一个相对较小的团队中脱颖而出,成为了AI领域的一大竞争者。

DeepSeek-V2因其性能卓越及开源、可免费商用的优势而受到业内关注。DeepSeek官方解释称,V2采用了创新的架构,如MLA(多头潜在注意力)和DeepSeekMoE架构等,以实现更高经济性的训练效果和更高效的推理。这种在训练效率和成本方面的优势使得DeepSeek成为了国内最早开启大模型降价的厂商之一。

DeepSeek的成功并非偶然。据报道,DeepSeek是除中国互联网大厂外,唯一一家储备了万张A100芯片的公司,为其早期的技术研发提供了坚实的算力基础。创始人梁文锋,一位80后的浙江大学电子工程系毕业生,以其低调和专注的研究态度,赢得了业内的尊重和认可。

DeepSeek的成功,不仅是技术上的突破,也是在商业战略上的明智选择。他们以200人左右的小团队,不依靠外部融资,做出了一个有性价比并被全球主流AI界人士所认可的大模型。这一成就,不仅源于他们在早期就购买了大量算力卡并投入了大量资源进行研究,也因为他们专注于模型开发,不像大厂有其他盈利需求,也能更专注于模型开发。

本文来自作者[scysry]投稿,不代表杨森号立场,如若转载,请注明出处:https://vip.scysry.com/zixue/202412-102263.html

评论列表(4条)

我是杨森号的签约作者“scysry”!

希望本篇文章《95后AI领域新星令人瞩目 雷军开出千万年薪抢夺人才! (新晋95后)》能对你有所帮助!

本站[杨森号]内容主要涵盖:国足,欧洲杯,世界杯,篮球,欧冠,亚冠,英超,足球,综合体育

本文概览:DeepSeek,这个名字在人工智能领域引起了轩然大波,不仅仅是因为它在大语言模型领域取得了显著的进展,更是因为其背后的关键开发者之一——95后AI天才少女罗福莉,她不仅参与了...